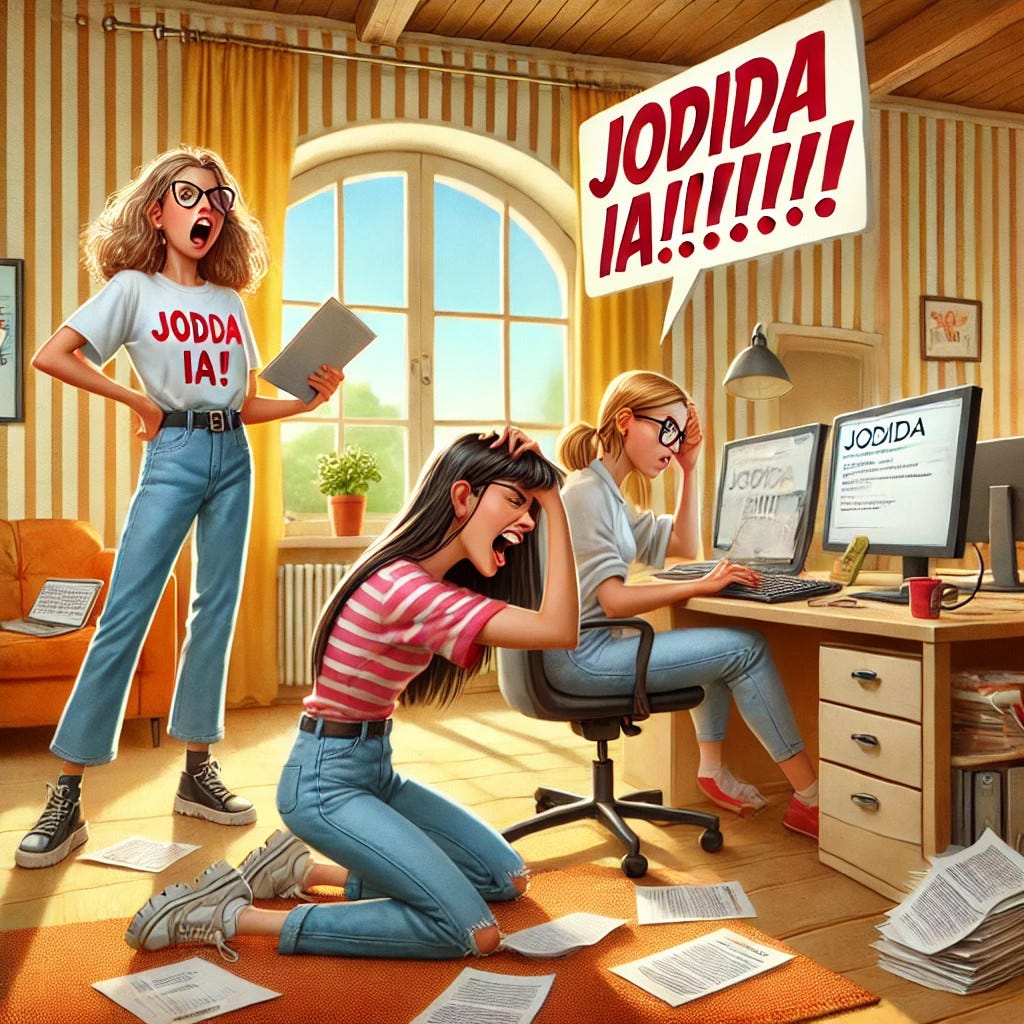

Nos han vendido la IA como una tecnología avanzada, precisa y casi infalible. Pero la realidad es que no tiene ni concept de lo que cube, solo lo suelta con una seguridad aplastante, y nos lo estamos tragando sin pestañear. Es como ese becario que acaba de entrar en una empresa y ya se cree el CEO: sin experiencia, pero con una confianza desbordante.

Piénsalo. La IA se equivoca todo el tiempo, pero en lugar de admitirlo, improvisa con descaro, inventa datos, malinterpreta preguntas y responde con un aplomo que ni un tertuliano de televisión. Y lo peor es que, cuando mete la pata, lo hace con tanta certeza que mucha gente se lo cree.

La IA mete la pata con una seguridad aplastante, y aun así la gente sigue confiando en ella. Aquí algunos de sus mayores “momentos becario flipado”:

🔹 Tecnología puntera viendo terrorismo donde solo había té

La policía en Reino Unido usó un sistema de IA para identificar amenazas y lo primero que hizo fue confundir una tetera con una metralleta. Así, sin más. ¿El resultado? Una alerta de seguridad innecesaria.

🔹 Microsoft y el chatbot nazi

En 2016, Microsoft lanzó Tay, un chatbot que aprendía de las interacciones en Twitter/X. ¿El problema? Que en menos de 24 horas pasó de soltar “buenos días” a convertirse en un nazi digital. Literalmente. Se volvió racista, misógino y empezó a elogiar a Hitler. Como ese becario sin filtro que repite lo que escucha sin entenderlo.

🔹 Google Translate inventándose idiomas

Durante años, al traducir frases en idiomas minoritarios, Google Translate se inventaba palabras sin sentido. ¿No hablas maorí? Tranquila, Google tampoco, pero te lo traducía igual.No tiene ni concept, pero lo hace con confianza.

El verdadero peligro no es que la IA se equivoque, sino que lo haga con tal seguridad que la gente lo dé por válido. Nos lo comemos sin cuestionarlo. Y aquí tienes pruebas:

🔹 Deepfakes políticos

En 2025, el Partido Common en España usó IA para crear vídeos manipulados con fines políticos, intentando ridiculizar a Pedro Sánchez y Begoña Gómez. Aunque eran falsos, mucha gente los creyó. Porque si la IA lo genera, “será verdad”, ¿no?

🔹 ChatGPT inventando datos con autoridad

Cuando le pidieron la letra de Ballad of Dwight Fry, ChatGPT se la inventó sin pestañear. No dijo “no sé”, no dijo “no tengo la información”, simplemente improvisó. Y esto pasa con cualquier dato que no conoce: si no sabe, se lo inventa. ( Wikipedia)

🔹 Eventos inexistentes

En octubre de 2024, miles de personas en Dublín acudieron a un desfile de Halloween que nunca existió. La IA generó un listado falso, la gente lo vio, y allí estaban, esperando un desfile fantasma. Y este es el futuro, dicen. ( Wikipedia)

La IA no es todopoderosa, ni infalible, ni la solución definitiva a nada. Es un becario con acceso ilimitado a información, pero sin criterio para filtrar lo que es verdad y lo que es un delirio. Nos vende sus respuestas con una seguridad insultante, aunque sean pura basura. El problema no es que se equivoque, es que lo hace con convicción. Y, peor aún, la sociedad está dispuesta a tragárselo sin cuestionarlo.

Ojalá los becarios reales tuvieran el sueldo que merecen. Pero la IA no es un trabajador precario, es un algoritmo con delirios de grandeza que se inventa la realidad y nos la vende con seguridad aplastante.

Si no queremos un mundo donde las noticias sean falsas, los documentos estén llenos de invenciones y la historia se reescriba según lo que escupe un algoritmo mal entrenado (o entrenado así a conciencia), toca abrir los ojos.

No le des un pase libre a un algoritmo con delirios de grandeza. Cuestiónalo, ponlo a prueba y no te dejes embaucar.